Un ictus a 19 anni paralizza per tutta la vita una donna, non più in grado di muoversi. Può fare soltanto piccolissimi movimenti o con il petto mentre respira o serrando leggermente il pugno delle mani. Tuttavia, un sistema di intelligenza artificiale collegato a uno schermo riesce a comprendere cosa vuole dire, cosa sta pensando e le sue volontà soltanto riprendendo il volto e percependo questi piccoli segnali.

La paziente colpita da ictus giovanissima si chiama T16 e ha partecipato a un esperimento che potrebbe cambiare la vita di altre persone completamente immobilizzate a letto. I chirurghi ricercatori della Stanford University della California hanno applicato chirurgicamente degli elettrodi nella parte anteriore del cervello. Un computer AI ne decodifica i segnali generati dai neuroni.

Ci sono altri tre pazienti gravi nella ricerca, affetti da SLA, una malattia neurologica completamente invalidante. Anche loro possono comunicare grazie alla tecnologia in grado di tradurre istantaneamente i pensieri umani. Questa tecnologia è “lettura della mente” applicata da anni e in contesto medico riabilitativo.

Mind-capping è la definizione di lettura della mente per i giapponesi che partecipano alle ricerche di una tecnologia che esiste dagli anni Sessanta/Settanta, oggi prodotto di consumo commerciabile

Ad agosto 2025, i ricercatori hanno reso pubblici i risultati di questa nuova tecnologia. I giapponesi la chiamano mind-capping, si possono ottenere descrizioni dettagliate di ciò che una persona vede e immagina senza proferire parola. Il mind-capping combina tre strumenti diversi di intelligenza artificiale, tutti e tre di scansione e traduzione cerebrale. I neuroscienziati stanno utilizzando questa tecnologia per comprendere nel profondo il cervello umano e la comunicazione. In futuro, l’IA della mente cambierà completamente come interagiamo ma anche il rapporto con ciò che abbiamo attorno.

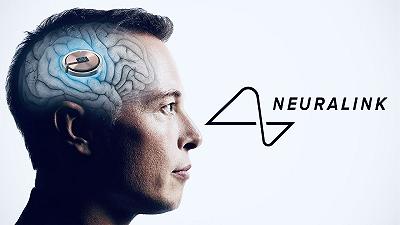

Secondo i neuroingegneri, la tecnologia mind-capping evolverà e diventerà anche prodotto commerciale, sentite le parole di Mainteyi Vaidya, esperto di interfacce cervello-computer del Neuroprosthetics Lab dell’Università della California. “Nei prossimi anni, inizieremo a vedere queste tecnologie prodotte commercialmente e ampiamente utilizzate“. La tecnologia cervello-computer (BCI) esiste da prima degli anni Settanta, gli ingegneri già la stavano pensando per diversi settori, dall’assistenza medica ad altri usi umani. E oggi ci sono aziende importanti che stanno investendo nelle ricerche, sui chip cerebrali commerciali è impegnata Neuralink di Elon Musk ad esempio.

Dai segnali neurali alle parole: come l’IA sta cambiando la comprensione del pensiero umano è stato pubblicato per la prima volta su Lega Nerd. L’utilizzo dei testi contenuti su Lega Nerd è soggetto alla licenza Creative Commons Attribuzione-Non commerciale-Non opere derivate 2.5 Italia License. Altri articoli dello stesso autore: Daniela Giannace